Блог Kodik

Новости, обновления и полезные статьи о разработке с использованием ИИ.

Если у вас в менеджере паролей завелась отдельная папка с заголовком вроде «API нейросетей», и в ней лежат токены языковых моделей от OpenAI, Anthropic, Google, DeepSeek и ещё пара экспериментальных провайдеров — вам знакомо, как неудобно между ними переключаться. Мы собрали KodikRouter именно для того, чтобы эту папку можно было схлопнуть в один понятный сервис.

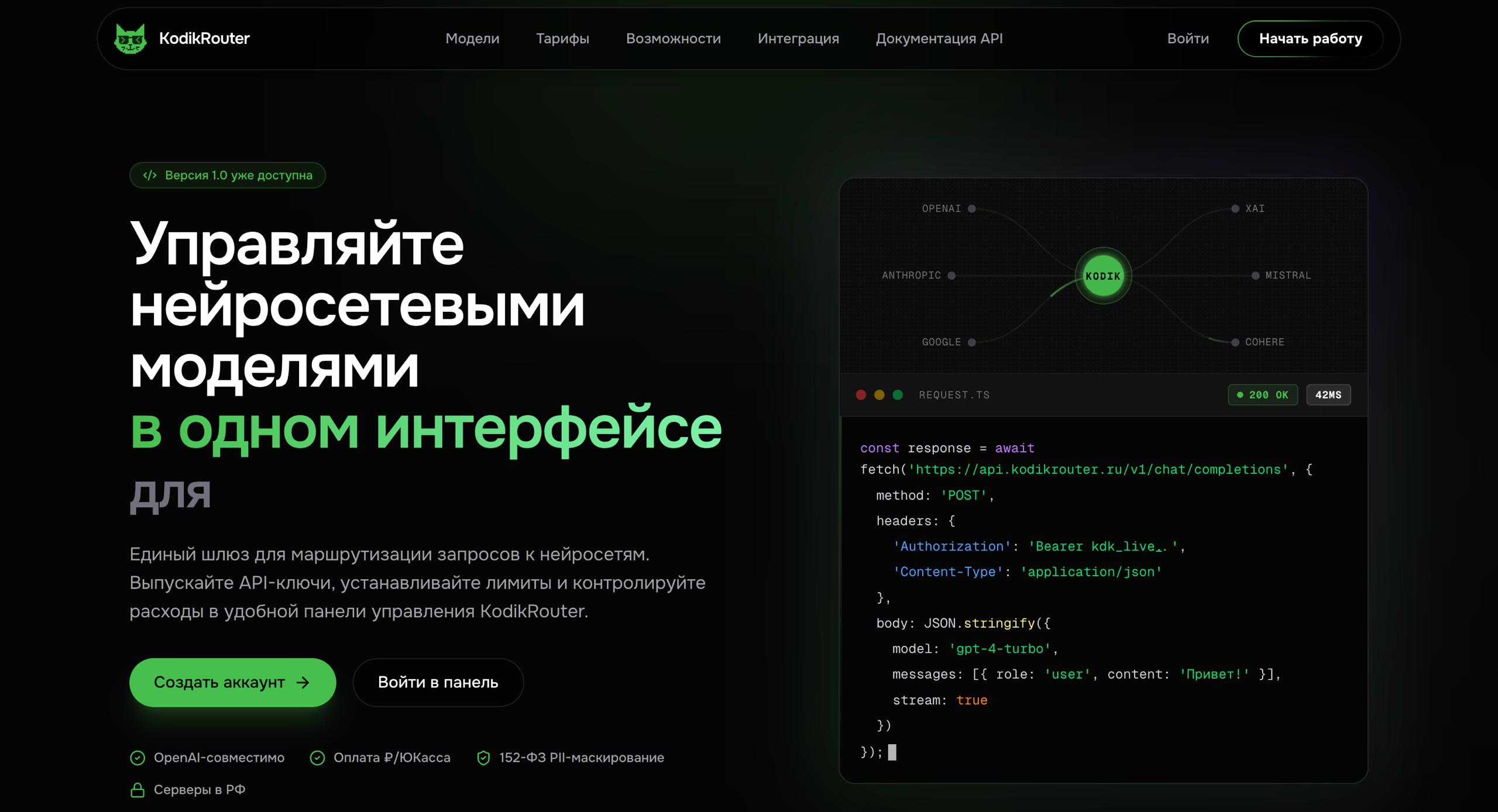

Рады представить наш агрегатор генеративных ИИ. Это единый API-шлюз ко всему нашему парку моделей. Один ключ, ~400 моделей под капотом, OpenAI-совместимый формат запросов и оплата с рублёвой карты. В статье — подробно о том, что это значит на практике.

История у всех примерно одинаковая. Сначала разработчики подключают GPT-4о — потому что с него все начинали. Потом приходит задача, под которую Claude подходит заметно лучше, и появляется второй ключ. Потом коллега приносит бенчмарк, где DeepSeek решает ваш кейс в десять раз дешевле по расходу токенов, и появляется третий ключ. Через полгода у вас в проекте четыре SDK, пять способов считать стоимость запроса, разные форматы ошибок и три разных способа стримить ответ. Не говоря уже об аналитике расходов, непредсказуемой стоимости запросов... А ещё знакомая всему РФ-сегменту разработки боль с оплатой: зарубежные карты работают с нюансами, юрлица бьются головой о валютный контроль, физлица переплачивают посредникам.

KodikRouter закрывает все эти вопросы одним сервисом. Вы один раз получаете наш ключ, один раз меняете ключ в коде — и дальше переключаетесь между основной моделью и резервной моделью просто меняя строку с названием модели в запросе. Никаких новых SDK, никаких отдельных кабинетов, никаких походов за зарубежной картой.

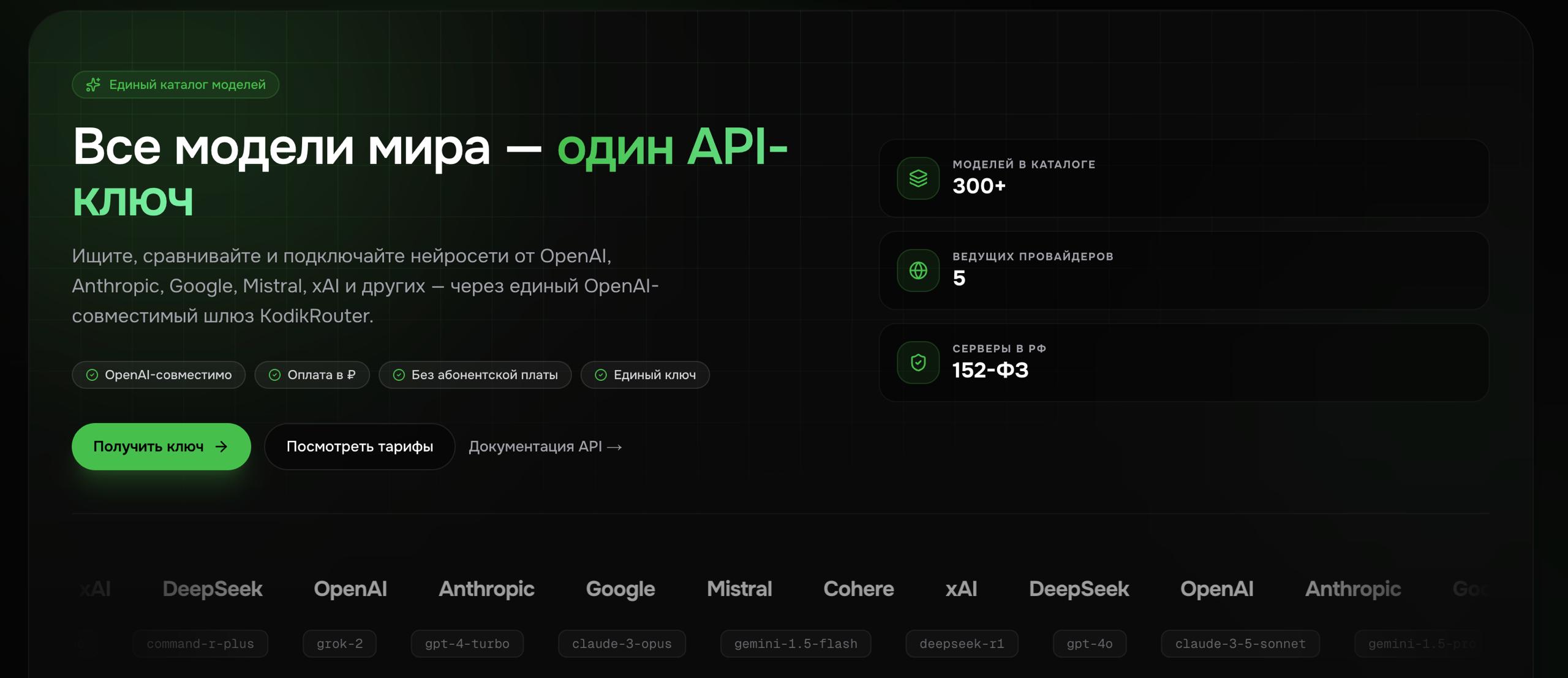

Под капотом у роутера — флагманы и рабочие лошадки от всех заметных игроков рынка. OpenAI (вся линейка ChatGPT API, включая Codex и o-серию), Anthropic (Claude API для Opus, Sonnet, Haiku), Google (Gemini API для Pro и Flash разных поколений), DeepSeek (включая R1 и V4 обеих версий), Qwen, GLM, Mistral, Cohere, xAI Grok — и это только начало списка всех доступных LLM API. Полный каталог моделей с актуальными ценами лежит на странице https://kodikrouter.ru/models, мы стараемся подключать новые модели в день релиза.

Совместимость с OpenAI API — это совсем не маркетинговая натяжка. Если у вас уже есть код на официальном SDK от OpenAI — на Python, Node, Go, чём угодно — миграция занимает ровно две строчки.

Меняете base_url, меняете ключ — и всё, готовый OpenAI-совместимый API. Бизнес-логика остаётся какой и была, библиотеки те же, обработка ошибок та же. Стриминг по SSE работает из коробки, вызов функций тоже. Если ваш код уже умеет в OpenAI, он автоматически научится в Anthropic, Google и остальных. Бесшовная интеграция во внутренние сервисы.

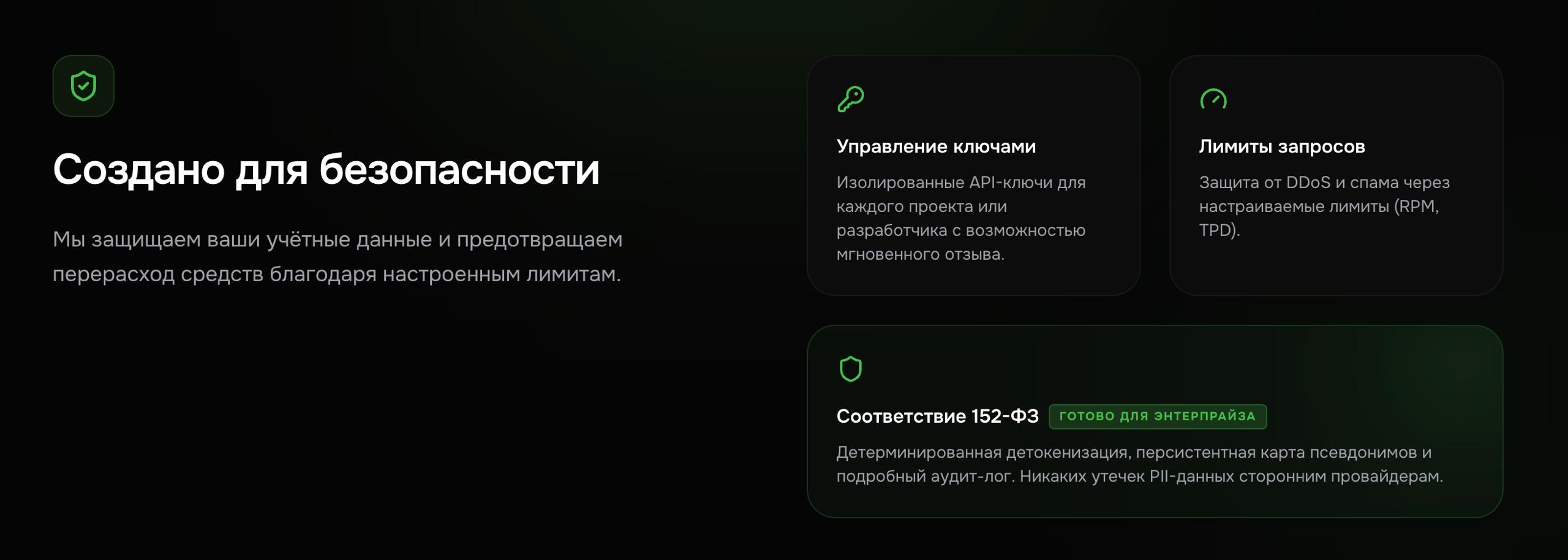

KodikShield — наша разработка, ради которой к нам обращаются корпоративные заказчики, и которой мы тихо гордимся. Большинство провайдеров моделей находится за пределами России — а значит, отправляя в модель письмо клиента, медицинскую карту или внутреннюю переписку, вы фактически передаёте персональные данные за рубеж. Это и юридически неверно (152-ФЗ имеет на этот счёт развёрнутое мнение), и попросту некомфортно.

KodikShield — слой маскирования персональных данных, который встроен прямо в роутер. Подключается опциональным флагом перед запросом.

Работает так: · Запрос уходит из вашего приложения с реальными данными — именами, телефонами, номерами карт, СНИЛС, email, внутренними доменами, API-ключами в коде. · На стороне шлюза, до отправки в модель, уязвимые данные детектируются и заменяются на детерминированные псевдонимы вида [ИМЯ_1], [СНИЛС_1], [EMAIL_2]. Карта замен сохраняется в рамках запроса. · К провайдеру улетает уже обезличенный текст. Модель работает с псевдонимами и возвращает ответ, в котором эти же псевдонимы фигурируют. · На обратном пути роутер бесшовно восстанавливает реальные значения — пользователь получает осмысленный ответ с настоящими именами и номерами, а к провайдеру ничего лишнего не утекло.

Вуаля, гарантированная безопасность данных.

Детерминированность здесь важный момент. Иван Иванов в одном запросе всегда станет [ИМЯ_1], а не [ИМЯ_1] в одном месте и [ИМЯ_7] в другом — иначе модель просто запутается и склеит контекст неправильно. Под капотом — персистентная карта псевдонимов и подробный аудит-лог: можно посмотреть, что именно было замаскировано в конкретном запросе.

Сценарии, где это спасает: суммаризация медицинских карт, разбор клиентской переписки, помощь с разбором логов с продакшена, любая работа с документами, где нужно обезличивание персональных данных — к примеру, есть PII или коммерческая тайна.

Когда работаешь с одной моделью через её родной кабинет, со статистикой ещё можно жить. Когда моделей пять — начинается ад из табличек в гугловском экселе и попыток свести стоимость месяца. Мы сделали единую панель в личном кабинете, где видно всё и сразу. Что показываем: расход токенов и денег в разрезе по моделям и по API-ключам, средняя стоимость запросов, задержки запросов (latency), процент ошибок, графики во времени, rate limits, статистику запросов. Можно увидеть, что вот этот ключ, который мы выдали стажёру, за неделю съел больше, чем весь продакшен — и спокойно его отозвать или ограничить.

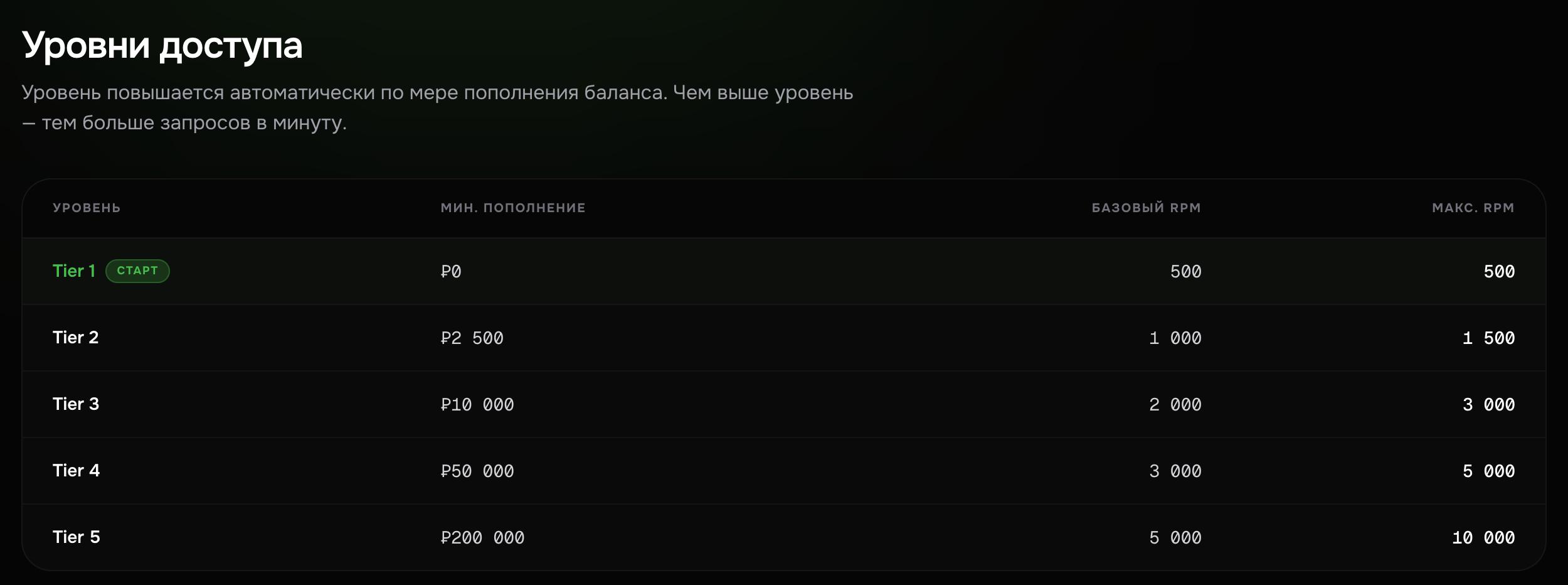

Все токены доступа можно создать с лимитами: rate limit (запросов в минуту), tokens per day, потолок по кредитам. Если превысили то получаете стандартную ошибку 429 и спите спокойно. Бонусом — фолбэки и маршрутизация.

Если основной провайдер прилёг или отдал ошибку 500, роутер может автоматически переключить запрос на резервную модель — настройки гибкие, можно выстроить цепочку «сначала пробуем дешёвую, если упала — пробуем модель подороже».

Пополнение баланса идёт через ЮКасса: рублёвая карта, СБП, юрлица через счёт с НДС. История транзакций прозрачная, чеки приходят на почту, а бухгалтерии остаётся стандартный комплект закрывающих документов.

Тарификация устроена максимально справедливо: цена провайдера API нейросетей плюс 10% за маршрутизацию, аналитику и поддержку. Здесь без обмана — абонентских платежей, ежемесячных подписок и минимальных порогов. Не пользовались месяц — не платите. Сделали один запрос — заплатите за один запрос.

Для энтерпрайза есть отдельный тариф с SLA 99.95%, индивидуальным DPA, опцией on-premise развёртывания, личным аккаунт-менеджером.

· Соло-разработчику, который ведёт два-три пет-проекта на разных моделях и устал жонглировать ключами. Особенно если хочется в выходные попробовать новую модель, но лень регистрировать ещё один аккаунт и привязывать ещё одну карту. · Продуктовой команде, которая выкатывает фичи на LLM в продакшен. Тут особенно ценны изолированные ключи на окружения, лимиты, единая аналитика и возможность переключать модели без релиза — просто меняя конфиг. · Корпоративным заказчикам, для которых критичны 152-ФЗ и сохранность чувствительных данных. KodikShield плюс серверы в РФ плюс подробный аудит-лог закрывают большинство вопросов compliance-отдела ещё до того, как они будут заданы. · Исследователям и аналитикам, которым нужно прогонять одну и ту же задачу через десяток моделей и сравнивать качество обработки естественного языка. Один ключ, один скрипт, в цикле меняется только имя модели — и в конце готовая таблица результатов с ценой и временем по каждой.

Заходите на kodikrouter.ru, регистрируетесь, пополняете баланс в личном кабинете KodikRouter на любую сумму, выпускаете свой первый ключ. Меняете в своём коде base_url — и всё, дальше можно пробовать любую из 400+ моделей одним и тем же запросом. Документация и Playground для быстрых экспериментов находятся там же, в личном кабинете.

Если у вас сложный кейс, нужен on-premise или хочется обсудить интеграцию с вашим стеком — пишите админу в Telegram (t.me/Kodik_Ai) или на основном сайте через enterprise-форму, разберёмся.

Удаляйте эту папку с ключами. Пора.